「分かります」、「共感します」「私もです」。このように単純でも深い気持ちのこもった言葉があります。それらには、他人と有意義に繋がりたいという私たちの人間性が表れています。それらはまた、ディープテックのイノベーターである当社が、人間と機械が対話するシステムで共感性を実現するという、画期的で社会を変える可能性のある課題に取り組む中で、重要な要素と位置付けています。

人間と機械の相互理解を研究する当社のチームは、AIの共感性に関する初期段階の研究に現在取り組んでいます。この記事では、この研究を推進し特徴づけている本質的な問いに向き合います。すなわち、共感性のある機械とはどういうもので、その開発が人間にとってなぜ重要か、ということです。ビジネス環境やウェルビーイングの分野での実例を紹介しながら、鍵となるポイントを説明します。

それではまず、共感性を人工的に開発することがなぜ今重要だと考えているか、という点から始めましょう。その答えははっきりしています。ここ最近、こうした革新的で破壊的なAI応用技術を備えた機械の驚くべき可能性についてより広く本格的に認識されるにつれて、機械はより高度な能力を獲得し、より困難な課題を解決するために連携するようになってきています。それでも、そうした期待感の影には、安全性、プライバシー、倫理についての懸念があります。そのバランスを取ることが必要です。

人をさらに深く理解して、快適かつ安全に協調作業ができるような共感性AIを開発することによって、現在のトレンドから見える新しいニーズに備える必要があります。もし機械が人の感情や動機、さらにそれらの行動への影響を理解できれば、さらにパフォーマンスを伸ばして生活を改善することが可能となり、確実に生産性を高め、持続可能性の目標を達成することもできるでしょう。

ビジネス面で見ても莫大な可能性があります。意欲を持った企業が、人間と機械の相互理解という可能性を他に先駆けて利用すれば、計り知れない機会が待っていると当社では考えています。AI、計算モデル、センシングを適用することにより、人間の理解が強化されます。感情を備え社交性に優れた製品やサービスの新しい波に、多くの人が引き寄せられるでしょう。今日の最も洗練されたユーザーインターフェースさえも、精彩に欠け、退屈で、完全に冗長なものになってしまうはずです。

共感性AIとは何か

では、機械に共感性があるというのは何を意味するでしょうか。共感というのは、誰か別の人の立場に立って、その人の観点で物事を理解する能力です。この能力によって人は他人に合わせ、時間をかけて関係を深めていくことができます。

これまで、機械は共感能力を備えるようには開発されてきませんでした。心理学的な知見を次世代のAI応用システムに組み込む方法が見つかれば、人間を理解できる適応能力がある機械の構築に向けて一歩前進できます。人間の交友関係を完全に体現することはできないでしょうが、それでも現在よりは確実によくなるはずです。

人間と機械の相互理解に優れたテクノロジーがなぜ重要か、もう少し深く検討しましょう。私たちは日々、個人、業務、社会のレベルでテクノロジーと関わっていますが、それには理由があります。

人間と機械がハイブリッドで協調するチームは、人間のみのチームや機械だけのチームよりも優れた働きができることが、研究や経験により示されています。がんの診断から倉庫の在庫管理までさまざまな分野で、人間の戦略的な判断と疲れ知らずの機械による戦術的な鋭さの組み合わせは、良い結果を導き出します。

現在のトレンドとして、こうした人間と機械の対話は、単に頻度が増えているだけでなく、その複雑さも増しています。予測分析、言語処理、生成の力を備え、それらをクラウド上のエコシステムとエッジデバイス上で統合した機械は、隠れたトレンドを明らかにし、課題を先取りし、解決策を提案することで私たちを助けてくれます。

その結果、我々私たち人間と協調してより難しい課題に対応することができます。その次には、私たちが機械に指示して共同作業できるようなテクノロジーに投資し、その強みによって目標が達成できるようにすることが必要です。これこそが、共感性を備えた機械、つまり特定のタスクをうまく実行できるだけでなく、人を理解して真の要求を満たし、共にタスクをうまく遂行できるような機械の必須条件です。

共感というのは、感情を理解することだけでなく、他者の認知的経験や社会的経験に関与することでもあります。両者はそもそも相互に無縁ではありません。共感によって私たちは相互の求めるものに順応し、目標としていることやその理由を共有できるようになります。こうしたメンタルモデルの共有は、個人的にも業務においても、私たち人間が相互に協調できるための鍵になります。

現状のところ、機械はそのように設計されていません。人間のふるまいの特定の側面には反応できるかもしれませんが、そのふるまいの意味や、どのようなメンタルプロセスによってそのふるまいが生じたかを推論しようとはしません。私たちとともに動作する機械は、行動についてどう考えたり感じたりしているか、なぜその行動をしているか、私たちの意図やふるまいに何が影響しているかなどの状況を、ほとんど理解していないのです。

そのため、相手を理解し、適応し、メンタルモデルを作り上げるのは、完全に人間の側の責任です。機械の側から歩み寄ったり、相互の理解の齟齬を解決しようとしたりすることはありません。

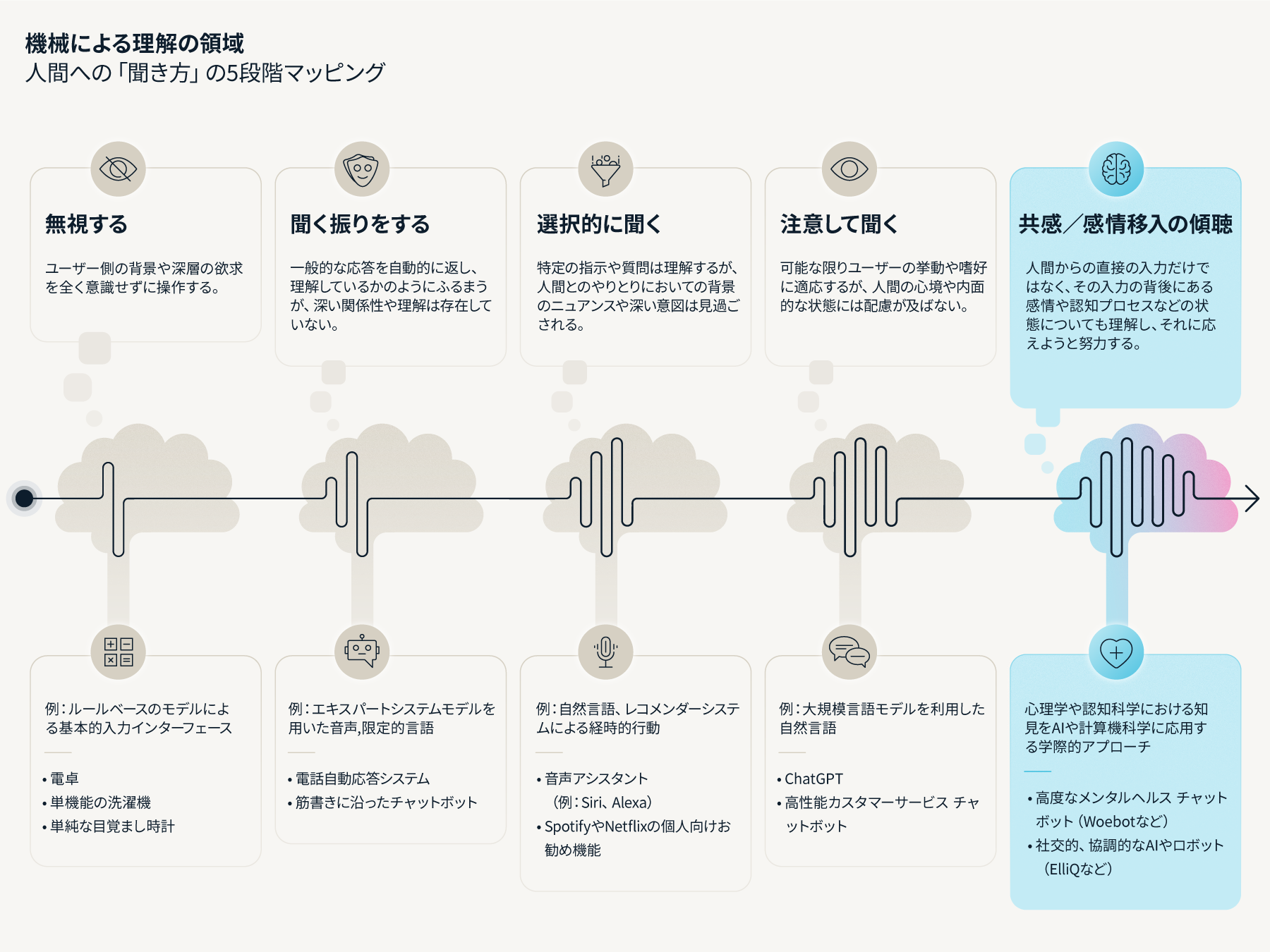

人間とのやり取りにおける機械の理解度を分類する方法は多数あります。スティーブン・コヴィーの著作「7つの習慣」で述べられている「聞き方」の5つのレベルをご存知かもしれません。これと同じ分類で機械による人間の理解のレベルをマッピングしてみます。そもそも、すべての機械が共感性を備える必要はありません。実際のところ、ユースケースによっては、この5段階のどの領域でも完璧に機能し得るのです。電卓は、機能を果たすために共感を必要とはしないので、「無視する」のレベルで十分です。それぞれのレベルでの機械の例と、その実現に必要な基盤技術を示しました。この領域は時間軸を反映しているものではありません。技術的な革新があれば、どの種類の機械についても幅広く適用し、人間の理解度の深さにかかわらず、機能を向上させることが可能です。

一方、共感性を備えた機械は、実施するタスクに関するモデルと、協調する相手の人間に関するモデルの2つを使用して動作します。ちょうど私たちのメンタルモデルが共同作業を進めるほど進化するのと同様、これら2つのモデルはやり取りを経て徐々に改善され、ついには共有されたメンタルモデルに収束します。このような能力を持つ機械によって、私たちの労働環境から個人の生活に至るまで、あらゆるものに革新が起こります。

工場の作業スペースに共同作業ができる組立ロボットがあったとしましょう。ユーザーがロボットのリズムや動作に合わせる必要がある場合において、ロボットは既定のタスクを実行するだけでなく、ロボットがユーザーのふるまいを観察してそれに合わせます。人間のふるまいとともに環境も観察して、意図や好み、何を求めているかを判断します。それによって、必要なことを必要なときに支援できます。

こうした能力があれば、ウェルビーイングの分野では、人間の理解を通じて機械のコンパニオンがメンタルヘルス管理や個人的な成長をサポートできます。ここで目指すべきは、人間のセラピストや心理療法士の置き換えではなく、治療と平行して、あるいは初期のトリアージに使用できる信頼性の高いツールとして提供することです。

最近のことですが、知能ロボットを職場におけるウェルビーイングのコーチとして使用するケンブリッジ大学が実施した研究に、当社は参加しました。この研究は2023年のACM/IEEE Conference on Human-Robot Interactionで発表され、職場でのメンタル面のウェルビーイングにテクノロジーが役立つ可能性を示しました。この研究結果は、人にどう伝えるか、この場合は機械のウェルビーイングコーチの物理的な形態が、人間の参加者の受け止め方に重要な影響を及ぼすことを浮き彫りにしています。

当社は初期段階の学術的な研究の支援に力をいれていますが、これは将来の発展のために強固な科学的基盤を作り、自社の事業や社外のイノベーターや研究者が活用できる知見やリソースを獲得することが大切だという信念に基づいています。

人間中心のAIの課題

研究活動の中で直面するさまざまな課題の中でも最大のものが、人間を状況の中で理解することです。共感する技術に必要なのは、機械による人間の理解であることは明らかです。人間の挙動を観察して、何を考えているか、実行中のタスクについてどう感じているかを推論できることが必要です。メンタルプロセスが行動へどう影響し、その一方から他方をどう推論するかについてのモデルは、認知科学やAI、感情コンピューティングの分野で広く研究されています。

特定の限られたスコープにおいては有望な結果も得られていますが、汎用的なモデルの開発は実に困難です。人間の行動の理解と共感の創出は状況の中でのみ可能であるという事実があっても、それは容易にはなりません。私たちは、人間の行動について精通し観察した行動の状況を知ることで、相互の行動の裏にある意味を理解することができます。

人間の行動、たとえば部屋の間を歩き回っているということがよく分かっているというだけでは、何をしているかを理解するには不十分です。その状況を理解し、環境が相互作用を経てどう変化するかをモデル化すること(すなわち世界モデルの構築)がAIや自律システムの研究で最もホットなトピックになっています。

特定のタスクに絞って状況をモデル化し、その中での人間の行動を観察することで、その環境の範囲内において人間の行動を説明し予測するアルゴリズムを作成できます。また、ある状況の特定の行動に関する知識を別の状況に転換できるような抽象化手法の研究も進行しています。

当社ではこうした課題に取り組んでおり、最新のソリューションの価値を検討し、実世界の問題に適用しやすくなるよう拡張する方法を探求しています。

共感性AIにおける倫理と信頼性

では、もう1つの大きな課題である倫理と信頼性について考えてみましょう。共感性のある機械の構築には、人間の挙動や行為に関する多様な尺度が必要です。理解を深めるためには、密なコミュニケーションと観察が必要で、これはプライバシーに関する関心を高めなければ実現できません。

この問題の他にも、機械的な手段により高い主体性を与えて意思決定プロセスと行動を左右するような意思決定をさせることには、倫理上の疑問が生じます。悪意のある行動の心配だけでなく、人間の利用者に適切に反応する技術の完成度、それが与えうる影響範囲などが、安全性リスクの要因となります。

この分野で良い効果を及ぼそうとするテクノロジストは、こうした課題を認識し、その対応をできるだけ早期にソリューションの中に組み込むことが必要です。当社はこうした課題に正面から取り組んでいます。AIのエキスパートが、安全性、倫理、セキュリティなどの領域でのガイドラインに基づき、AI保証について強固なアプローチを定めています。責任あるAI開発を保証する方法については、こちらの記事をお読みください。 AI品質保証:次世代のビジネスイノベーションを保障する.